Papučica Za Šivaću Mašinu | Papučica Za Bagat | Papučica Za Pfaff | Papučica Za Singer | MAŠINSKI KUTAK

China Foot Pedal Tailor Light Sewing Machine Suppliers, Manufacturers, Factory - Wholesale Price - ZIHONG

China Foot Pedal Tailor Light Sewing Machine Suppliers, Manufacturers, Factory - Wholesale Price - ZIHONG

China Foot Pedal Tailor Light Sewing Machine Suppliers, Manufacturers, Factory - Wholesale Price - ZIHONG

Jutarnji list - KAKO SE RIJEŠITI RUŽE Najprije sam Ružu pokušala darovati prijateljicama i susjedama koje su, sve redom, sa smiješkom, odbile. Nitko je nije želio

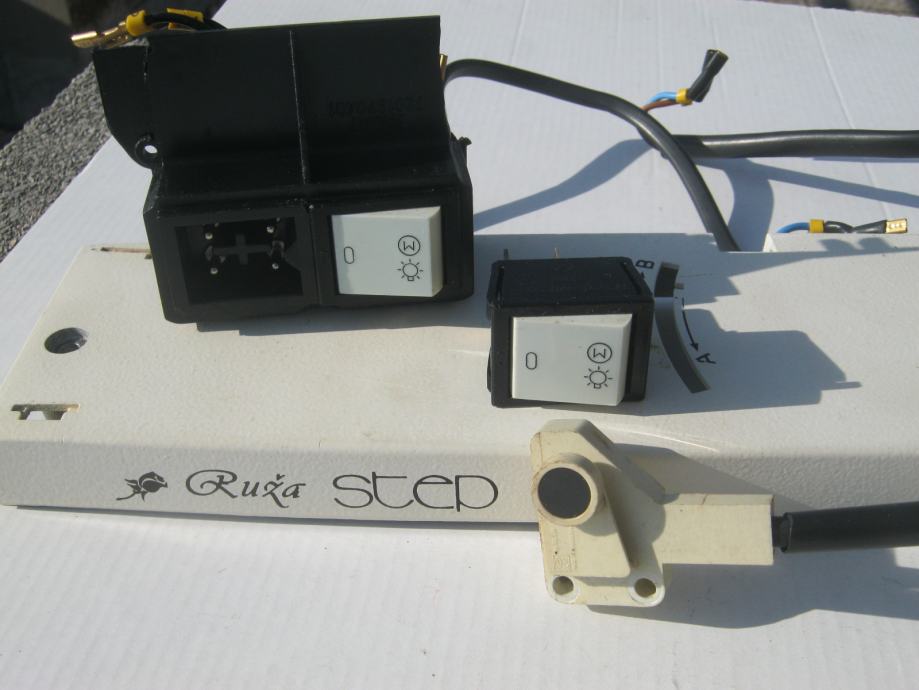

Papučica Za Šivaću Mašinu | Papučica Za Bagat | Papučica Za Pfaff | Papučica Za Singer | MAŠINSKI KUTAK

Papučica Za Šivaću Mašinu | Papučica Za Bagat | Papučica Za Pfaff | Papučica Za Singer | MAŠINSKI KUTAK