Cet article a été publié dans le cadre du Blogathon sur la science des données.

introduction

Aujourd'hui, parlons d'un des concepts fondamentaux de la statistique: distributions de probabilité. Ils aident à mieux comprendre les données et servent de base à la compréhension de concepts plus statistiques, tels que les intervalles de confiance et les tests d'hypothèse.

Définition informelle

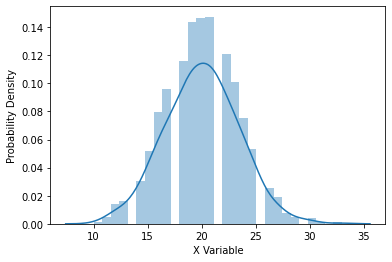

Soit X une variable aléatoire qui a plus d'un résultat possible. Tracer la probabilité sur l'axe des y et le résultat sur l'axe des x. Si nous répétons l'expérience plusieurs fois et traçons la probabilité de chaque résultat possible, on obtient un graphique qui représente les probabilités. Ce graphique est appelé la distribution de probabilité (PD). La hauteur du graphique pour X donne la probabilité de ce résultat.

Types de distributions de probabilité

Il existe deux types de distributions selon le type de données générées par les expériences.

1. Distributions de probabilités discrètes

Ces distributions modélisent les probabilités de variables aléatoires qui peuvent avoir des valeurs discrètes comme résultats.. Par exemple, les valeurs possibles pour la variable aléatoire X représentant le nombre de faces pouvant survenir lorsqu'une pièce est lancée deux fois sont l'ensemble {0, 1, 2} et pas n'importe quelle valeur de 0 une 2 Quoi 0.1 O 1.6.

Exemples: Bernoulli, Binôme, binôme négatif, Hypergéométrique, etc.,

2. Distributions de probabilités continues

Ces distributions modélisent les probabilités de variables aléatoires qui peuvent avoir n'importe quel résultat possible.. Par exemple, les valeurs possibles pour la variable aléatoire X qui représente le poids des citoyens dans une ville qui peut avoir n'importe quelle valeur telle que 34,5, 47,7, etc.

Exemples: Normal, T l'étudiant, Chi au carré, Exponentiel, etc.,

Terminologies

Chaque DP nous fournit des informations supplémentaires sur le comportement des données concernées.. Chaque PD est donnée par une fonction de probabilité qui généralise les probabilités des résultats.

Avec ça, nous pouvons estimer la probabilité d'un résultat particulier (discret) ou la probabilité qu'il se situe dans une plage de valeurs particulière pour un résultat donné (continu). La fonction est appelée fonction de masse de probabilité (CMP) pour les distributions discrètes et la fonction de densité de probabilité (PDF) pour les distributions continues. La valeur totale de PMF et PDF dans l'ensemble du domaine est toujours égale à un.

Fonction de distribution cumulative

Le PDF fournit la probabilité d'un résultat particulier, tandis que la fonction de distribution cumulative fournit la probabilité de voir un résultat inférieur ou égal à une valeur particulière de la variable aléatoire. Les CDF sont utilisés pour vérifier comment la probabilité a été additionnée jusqu'à un certain point. Par exemple, et P (X = 5) est la probabilité que le nombre de faces au lancer d'une pièce soit 5, P (X <= 5) désigne la probabilité cumulée d'obtenir de 1 une 5 visages.

Les fonctions de distribution cumulative sont également utilisées pour calculer les valeurs p dans le cadre des tests d'hypothèse..

Distributions de probabilités discrètes

Il existe de nombreuses distributions de probabilité discrètes à utiliser dans différents scénarios. Nous discuterons des distributions discrètes dans cet article.. Les distributions binomiale et de Poisson sont les plus discutées dans la liste suivante.

1. Distribution de Bernoulli

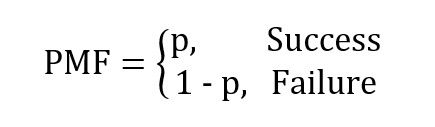

Cette distribution est générée lorsque nous effectuons une expérience une fois et elle n'a que deux résultats possibles: succès et échec. Les tests de ce type sont appelés tests de Bernoulli., qui forment la base de nombreuses distributions discutées ci-dessous. Soit p la probabilité de succès et 1 – p est la probabilité de défaillance.

Le PMF est donné comme

Un exemple de ceci serait de lancer une pièce une fois. p est la probabilité d'aller de l'avant et 1 – p est la probabilité d'obtenir une queue. Veuillez noter que le succès et l'échec sont subjectifs et nous les définissons en fonction du contexte.

2. Distribution binomiale

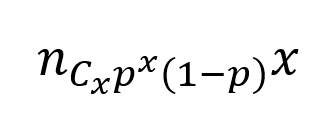

Ceci est généré pour les variables aléatoires avec seulement deux résultats possibles. Soit p la probabilité qu'un événement soit un succès, ce qui implique que 1 – p est la probabilité que l'événement soit un échec. Effectuer l'expérience à plusieurs reprises et représenter graphiquement la probabilité à chaque fois nous donne la distribution binomiale.

L'exemple le plus courant donné pour la distribution binomiale est de lancer une pièce n nombre de fois et de calculer les probabilités d'obtenir un nombre particulier de faces. D'autres exemples concrets incluent le nombre d'appels de vente réussis pour une entreprise ou si un médicament fonctionne ou non pour une maladie..

Le PMF est donné comme,

où p est la probabilité de succès, n est le nombre de tentatives et x est le nombre de fois où nous obtenons un succès.

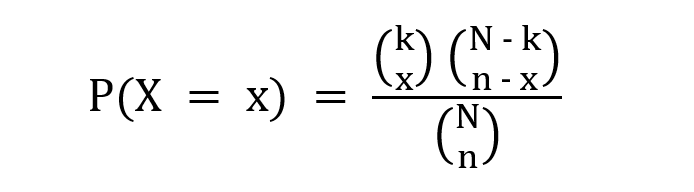

3. Distribution hypergéométrique

Prenons le cas du retrait d'une bille rouge d'une boîte de billes de couleurs différentes.. L'événement de tirer une boule rouge est un succès et ne pas le tirer est un échec. Mais chaque fois qu'un marbre est tiré, il n'est pas remis dans la boîte et, donc, cela affecte la probabilité d'obtenir une balle au tour suivant. La distribution hypergéométrique modélise la probabilité de k succès dans n essais où chaque essai est effectué sans remplacement. Ceci est différent de la distribution binomiale où la probabilité reste constante pendant les essais..

Le PMF est donné comme,

où k est le nombre de succès possibles, x est le nombre de succès souhaité, N est la taille de la population et n est le nombre d'essais.

4. Distribution binomiale négative

Parfois, nous voulons vérifier combien de tests de Bernoulli nous devons faire pour obtenir un résultat particulier. Le résultat souhaité est spécifié à l'avance et nous continuons l'expérience jusqu'à ce qu'il soit atteint. Prenons l'exemple du lancer de dé. Notre résultat souhaité, défini comme un succès, est d'obtenir un 4. On veut connaître la probabilité d'obtenir ce résultat trois fois. Ceci est interprété comme le nombre d'échecs (d'autres nombres que 4) que se passera-t-il avant de voir le troisième succès.

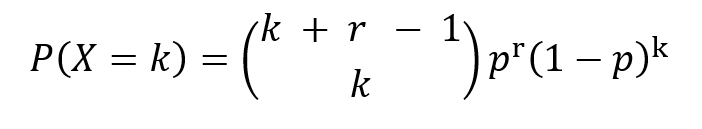

Le PMF est donné comme,

où p est la probabilité de succès, k est le nombre d'échecs observés et r est le nombre de succès souhaité jusqu'à l'arrêt de l'expérience.

Comme dans la distribution binomiale, la probabilité entre les essais reste constante et chaque essai est indépendant de l'autre.

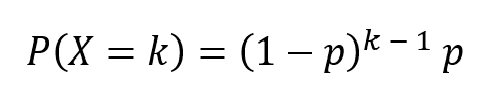

5. Répartition géométrique

Il s'agit d'un cas particulier de distribution binomiale négative où le nombre de succès souhaité est 1. Mesure le nombre d'échecs que nous obtenons avant un succès. En utilisant le même exemple donné dans la section précédente, nous aimerions connaître le nombre d'échecs que nous voyons avant d'obtenir les premiers 4 en lançant les dés.

où p est la probabilité de succès et k est le nombre d'échecs. Ici, r = 1.

6. Répartition du poison

Cette distribution décrit les événements qui se produisent dans un intervalle de temps ou d'espace fixe.. Un exemple pourrait clarifier cela. Prenons le cas du nombre d'appels qu'un centre de service client reçoit par heure. Nous pouvons estimer le nombre moyen d'appels par heure, mais nous ne pouvons pas déterminer le nombre exact et l'heure exacte à laquelle il y a un appel. Chaque occurrence d'un événement est indépendante des autres occurrences.

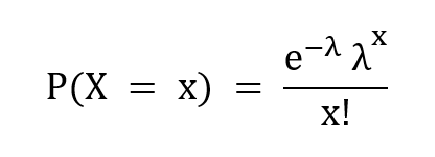

Le PMF est donné comme,

où est le nombre moyen de fois où l'événement s'est produit au cours d'une certaine période de temps, x est le résultat souhaité et e est le nombre d'Euler.

7. Distribution multinomiale

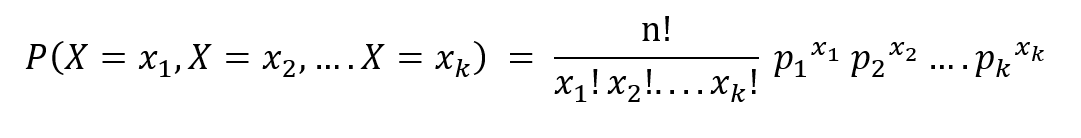

Dans les distributions précédentes, il n'y a que deux issues possibles: succès et échec. Cependant, la distribution multinomiale décrit des variables aléatoires avec de nombreux résultats possibles. Parfois, c'est aussi ce qu'on appelle une distribution catégorique, puisque chaque résultat possible est traité comme une catégorie distincte. Considérez le scénario de jouer à un jeu n fois. La distribution multinomiale nous aide à déterminer la probabilité combinée que le joueur 1 gagner x1 fois, le joueur 2 gagnera x2 fois et le joueur k gagne Xk fois.

Le PMF est donné comme,

où n est le nombre d'essais, p1,…… pagek désignent les probabilités de résultats x1……Xk respectivement.

Dans ce billet, Nous avons défini des distributions de probabilité et discuté brièvement différentes distributions de probabilité discrètes. Faites-moi part de vos réflexions sur l'article dans la section commentaire ci-dessous..

Les références

1. https://www.statisticshowto.com/

2. https://stattrek.com/

3. Wikipédia

Sur moi

Je suis un ancien ingénieur logiciel travaillant sur la transition vers la science des données. Je suis étudiant en Master Data Science. N'hésitez pas à me contacter sur https://www.linkedin.com/in/priyanka-madiraju/

Les médias présentés dans cet article ne sont pas la propriété de DataPeaker et sont utilisés à la discrétion de l'auteur.

En rapport

Articles Similaires:

- Les meilleures startups de l'IA | Les startups de l'IA à considérer 2021

- Reconnaissance faciale avec OpenCV | Créer un système de reconnaissance faciale

- Pourquoi les GPU sont-ils nécessaires pour former des modèles d'apprentissage en profondeur?

- Nuage de mot Python | Comment créer Word Cloud en Python?